来源:新智元编辑:Aeneas好困

快速定制模型的LLM引擎Lamini来了,开发者狂喜!

ChatGPT虽好,但始终有门槛。通常,只有拥有AI博士学位的大型机器学习团队,才能这样训练一个模型。

为了把这个门槛打下来,团队构建了Lamini引擎,从此,每个开发者都能够拥有从GPT-3训练ChatGPT的超能力!

划重点:可以商用!可以商用!可以商用!

项目地址:https://github.com/lamini-ai/lamini/

Lamini的开发团队表示,你需要的只是几行代码,就可以用托管数据生成器俩训练自己的LLM,包括权重和其他所有的内容。

此外,你也可以使用开源的LLM,用Lamini库对生成的数据进行微调。以及访问完整的LLM训练模块,使用从LoRa等速度优化,到虚拟私有云(VPC)部署等企业功能。

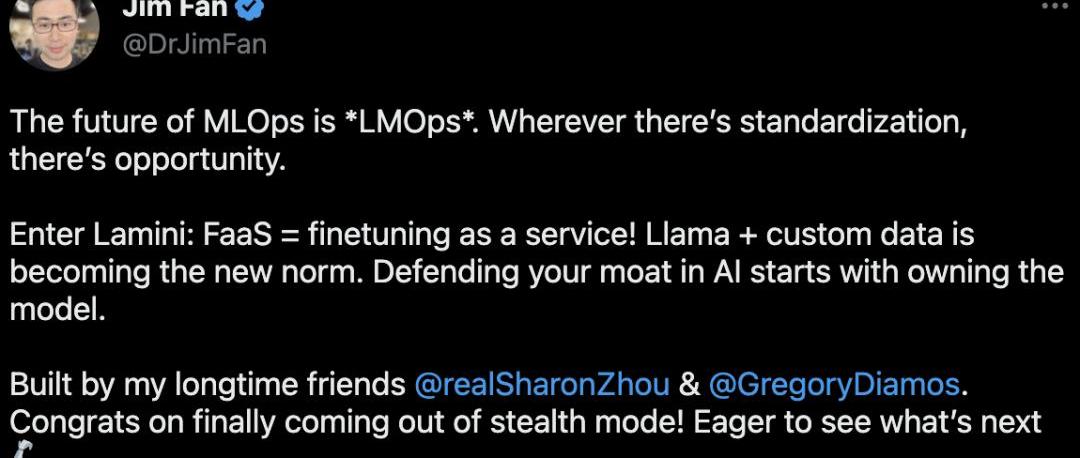

对此,英伟达科学家JimFan表示,LLaMa+自定义数据正在成为新的范式,而Lamini的推出也带了一种全新的模式——FaaS,微调即服务。

LSD稳定币协议Lybra Finance将于6月发布V2测试网:5月24日消息,LSD稳定币协议 Lybra Finance 将于 6 月发布 V2 测试网,并计划于 7-8 月启动主网。V2 版本中将基于 LayerZero 技术提供全链互操作性,并增加新的 LSD Token 作为抵押品。截至 5 月 23 日,Lybra V1 版本 TVL 超 6700 万美元,有超过 3.6 万枚 stETH 存款,协议以此为抵押共发行价值超 3400 万美元的 eUSD 稳定币。[2023/5/24 22:14:39]

MLOps的未来是「LMOps」。哪里有标准化,哪里就有机会。

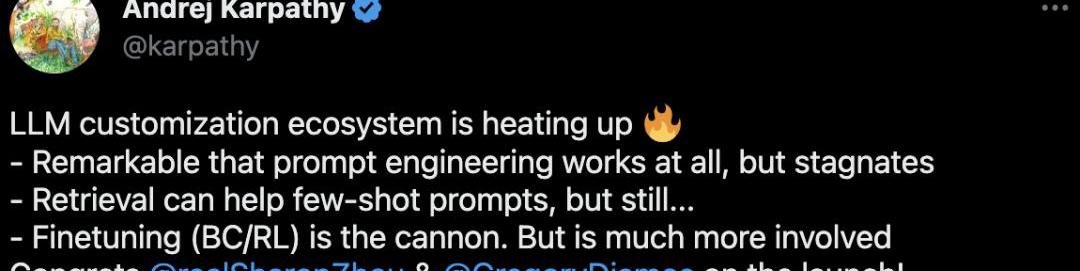

OpenAI科学家,前特斯拉人工智能总监AndrejKarpathy也表示,LLM定制化的生态正在愈发火爆。

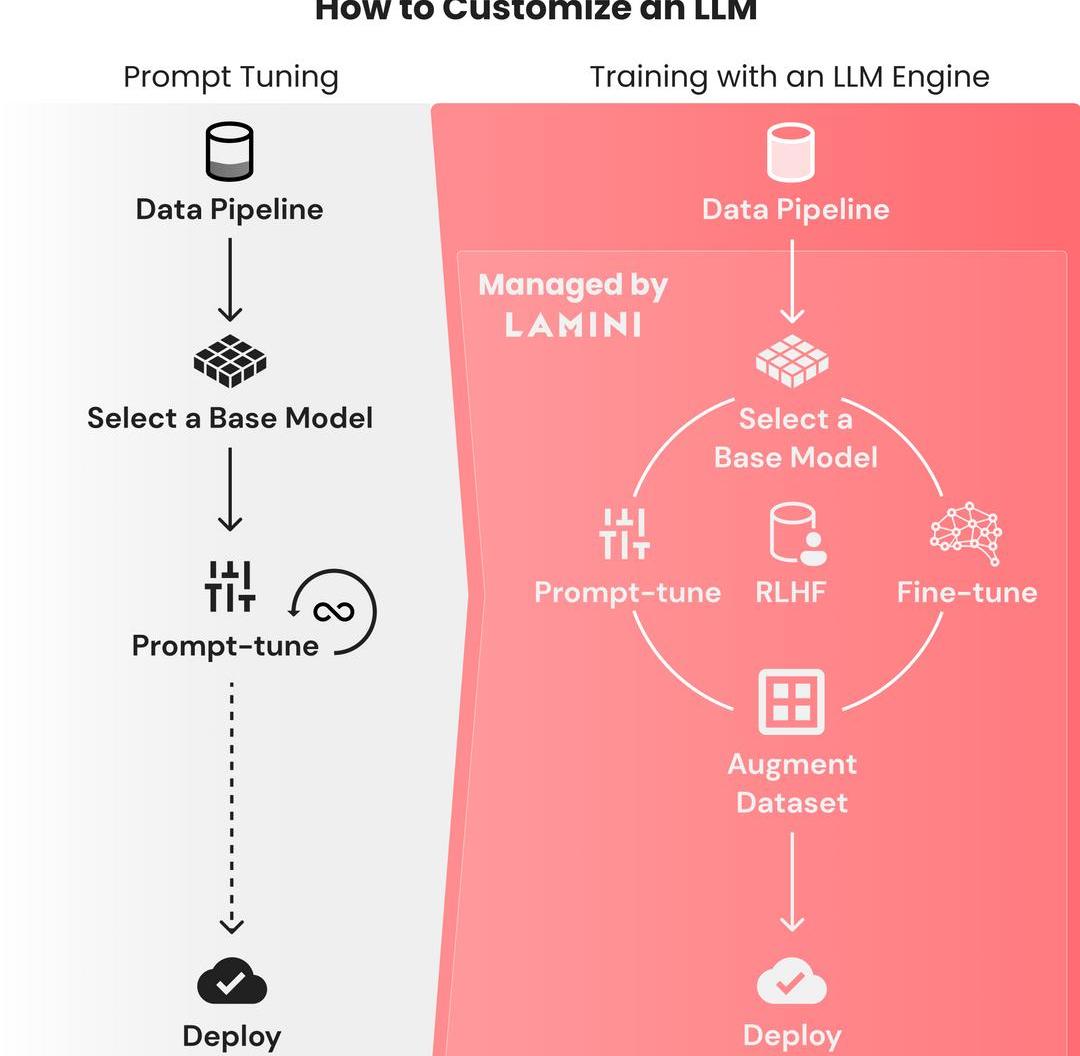

训LLM就像prompt-tuning一样简单

写一个prompt如此容易,但想要从基础模型训练出一个大语言模型,却是如此困难。

因为需要花费大量时间,来找出微调模型失败的原因,所以对数据集微调的迭代周期都是以月为单位的。

与之相反,微调prompt的迭代,只需要几秒钟,并且在几个小时内,性能都能保持稳定。

这个过程只需要把有限数量的数据整合到prompt中就可以了,并不需要动辄几TB的数据。

LSDx Finance已通过销毁5亿枚LSD剩余代币的提案投票:金色财经报道,全LSD超流动性协议LSDx Finance公布关于代币销毁提案投票结果,销毁5亿枚剩余代币的选项以97.29%的支持率获得通过。注:LSD原定总量是10亿,本次销毁5亿占比50%,销毁后总量变成5亿。[2023/4/20 14:15:24]

ChatGPT的诞生十分艰难,OpenAI的团队花了几个月的时间,在基础的GPT-3模型上微调,并进行RLHF。这个门槛极高,只有大型的ML团队才能完成这种训练。

有500强企业的技术负责人这样抱怨过:「我们团队的10名机器学习工程师用了OpenAI的微调API,结果我们的模型反而变得更差了,怎么办啊。」

「我真的不知道该怎么充分利用数据,我已经用尽了所有从在线教程中能学到的prompt魔法了。」

这,就是研究者构建Lamini的原因:让每个开发者可以直接从GPT-3训练ChatGPT。

任意LLM,秒变ChatGPT!

Lamini是一个LLM引擎,可以让不仅仅是机器学习专家的任何开发人员,都能在大型数据集中,把高性能的LLM训练得像ChatGPT一样好。

这个过程,只需要Laimini库的几行代码即可。

值得注意的是,这个库中的优化远远超出了现在开发者可以使用的范围,从更具挑战性的优化到更简单的优化。

比如,你想从不同的角度生成一个广告文案。

首先,从llama模块导入LLM引擎:

fromllamaimportLLMllm=LLM(name="marketing")

LSDx Finance上线ETHx:4月6日消息,全LSD超流动性协议LSDx Finance宣布ETHx上线,该产品以ETHx的代币形式覆盖一篮子的LSD资产,旨在分散风险的同时提升收益率,现由ETH、stETH、fraxETH、rETH四个代币资产组成。[2023/4/6 13:48:30]

接下来,需要定义输入和输出类型。注意,这里一定要包括上下文,因为可以有助于LLM在自然语言中进行理解。

fromllamaimportType,ContextclassAdAspects(Type):tone:str=Context("toneofthemarketingcopy")product_features:list=Context("productfeaturestopromote")audience:str=Context("targetaudienceforthemessage")subject:str=Context("subjectortopicofthemessage")goal:str=Context("goalofthismarketingcampaignandmessage")classAdCopy(Type):title:str=Context("googleadtitletag")description:str=Context("googleaddescription")keywords:list=Context("keywordsforthesearchengine")

然后就可以开始提问了:

语气:大胆,但不傲慢

特色:亚洲酱料和香料、家常调料和套餐包,可以轻松在家烹饪。

LSD协议unshETH在以太坊和BSC上推出v2版本,当前TVL已超2600万美元:金色财经报道,LSD协议unshETH日前在以太坊和BSC上推出v2版本。新版本包括为不同LSD Token设置风险隔离机制、新增多签和Timelock功能、以及启用首个上海升级后LSDfi产品vdAMM。vdAMM可将unshETH转换为AMM池,允许用户访问unshETH中的深度流动性并在不同的LSD之间进行交换。官网数据显示,协议当前TVL已达2648万美元。[2023/4/4 13:43:45]

aspects=AdAspects(tone="boldandbright,butnotarrogant",product_features=,audience="suburbanfamilies",subject="deliciousasianmealswithoutgoingtoarestaurant",goal="getsuburbanmomsanddadstotrybuytheirfirstomsompackorfreetastingkit")ad_copy=llm(input=aspects,output_type=AdCopy)print(f"Adcopy:{ad_copy}")模型输出:

尝试Omsom的美味亚洲酱料、香料、家常调料和套餐包。轻松为家人在家做出美味佳肴。

>title='DeliciousAsianMealsWithoutGoingtoaRestaurant|Omsom'description="TryOmsom'sdeliciousAsiansauces,aromatics,andhome-cookedseasoningsandmealpacks.Easilycookdeliciousmealsathomeforyourfamily."keywords=

LSDx Finance:团队并无卖币行为,将对未来金库地址采取多签管理:金色财经报道,全 LSD 超流动性协议 LSDx Finance 发推就社区的 red flag 质疑进行回应澄清,公布了资金池的地址,表示将做出改变来增加透明度和优化管理,包括会销毁 Proxy 中的铸造和管理员权限,对未来金库地址采取多签管理。

同时 LSDx Finance 称 LSDx 总供应量 10 亿,团队自始至终只提供了流动性,并没有卖币行为。[2023/3/20 13:13:54]

如何创建自己的「ChatGPT」

基础模型能理解一般的英语,但如果需要它们学习一些垂直语言和规则,prompt微调并不足够,很多时候我们都需要构建自己的LLM。

利用用下面这个步骤,就能获得像ChatGPT一样遵循指令的LLM。

尝试prompt-tuningChatGPT或其他模型

可以使用Lamini库的API,在不同模型之间快速进行prompt-tuning,只需一行代码,即可在OpenAI和开源模型之间切换。

Lamini库已经优化了正确的prompt,这样开发者就可以使用不同的模型,不必担心如何为每个模型设置prompt的格式。

构建一个包含输入-输出对的大型数据集

这些数据集会向模型展示,它应该如何响应输入,无论是遵循英文说明,还是以JSON响应。

研究者刚刚发布了一个只有几行代码的repo,使用Lamini库,仅从100个数据点中,就能生成50k数据点。

而且因为使用Lamini库来启动Lamini引擎,所以这个过程根本不需要用到GPU。

在repo中,已经包含一个开源的70+k数据集。

项目地址:https://github.com/lamini-ai/lamini/

在大型数据集上微调基础模型

除了数据生成器,研究者还发布了一个LLM,它使用Lamini对生成的数据进行了微调。以编程方式执行此操作的功能也会很快发布。

也可以把OpenAI的微调API作为起步。

在微调模型上进行RLHF

使用Lamini,就不再需要大型ML和人工标记团队来运行RLHF。

部署到云端

只需点击产品或功能中的API端点即可。

专为LLM打造的数据生成器

简单来说,依照以下几个步骤,就可以训练自己的大语言模型了。

用于优化prompt微调和类型化输出的Lamini库。

用于微调和RLHF的高级Lamini库,只需几行代码。

史上首个托管数据生成器,用于创建数据,来训练遵循指令的LLM。注意,已获得商业使用许可!

开源的指令跟随LLM,使用上述工具,只需几行代码即可完成。

数据生成器工作原理

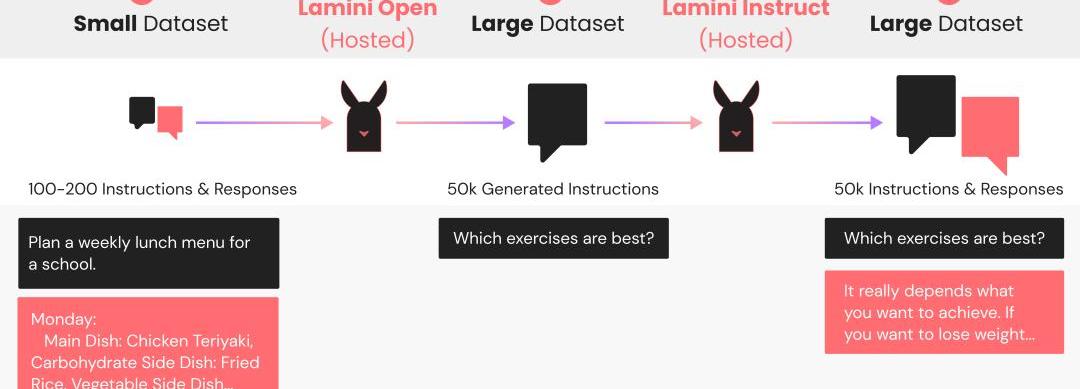

Lamini数据生成器是一个LLM管线,它采用原始的100多条指令的小集合,与预期的响应配对,生成50k+新的配对,灵感来自Stanford的Alpaca。这个生成管线使用Lamini库来定义和调用LLM,以生成不同但相似的指令和响应对。

根据这些数据训练后,你的LLM会遵循这些指示,因而得到改进。对于使用开源LLM的生成管线,研究者提供了一个很好的默认值,LaminiOpen和LaminiInstruct。

随着每天新的LLM发布,研究者都会将默认值更新为性能最佳的模型。在目前的版本中,LaminiOpen用的是EleutherAI的Pythia,LaminiInstruct用的是Databricks的Dolly。

LaminiOpen会生成更多指令,而LaminiInstruct会生成这些指令的成对响应。

最终生成的数据集可供免费商业使用,已经通过CC-BY许可。

仅用一行代码,就可以将Lamini库的默认值换成其他开源或OpenAI模型。

研究者发现,OpenAI模型的平均表现更好,但它们的许可限制了将生成数据用于训练类ChatGPT模型的商用。

对生成数据进行微调

在这个过程中,生成的数据会质量不一。

在微调之前,下一步就是将生成的数据过滤为高质量数据。

然后,Lamini会通过在这个过滤后生成的数据集上训练基础模型,来创建自定义LLM。

研究者已经发布了一个开源指令跟随LLM,可以用Lamini来训练Pythia基础模型,生成的37k指令是从70k中筛选出来的。

显然,Lamini库的出现,让迭代周期变得更快、更有效,有更多的人能够构建模型,而不仅仅是试验各种prompt。

团队介绍

SharonZhou是Lamini的联合创始人兼首席执行官。

个人主页:https://sharonzhou.me/

她在哈佛大学获得了计算机科学与古典文学联合学士学位,并以最高荣誉获得了硕士学位。

随后,她在斯坦福大学获得了计算机科学博士学位,师从吴恩达。

2022年,29岁的Zhou入选《麻省理工科技评论》「35岁以下科技创新35人」。

GregoryDiamos是MLPerf的联合创始人。

他曾是百度硅谷AI实验室的创始成员,对DeepSpeech和DeepVoice系统有贡献。

参考资料:

https://lamini.ai/blog/introducing-lamini

原文:PrivacyCoins101:Anonymity-EnhancedCryptocurrencies作者:Chainalysis区块链技术开创了财务透明的新时代.

来源/bankless 编译/Nick 本月的Shapella对以太坊来说意义重大,但扩展网络的工作才刚刚开始。今天,我们来看看以太坊在Shapella之后的发展方向.

作者:雨中狂睡 上海升级而产生的短期以太坊价格变化并不会影响LSD赛道和LSDFi赛道的潜力。不可否认的是,LSD资产和LSDFi应用已经成为了以太坊生态的重要组成部分.

博链财经BroadChain获悉,4月28日,据CoinDesk,数据显示,比特币的长期持有者近一年来首次盈利。从历史上看,长期持有者的盈利能力恢复预示着市场的大幅上涨.

Ethereum质押机制的现在和未来可以概括为以下四个方面: 市场领袖 最佳收益率 趋势 未来的催化剂 ETH在Crypto中拥有最好的Tokenomics.

原文作者:Messari-KunalGoel原创编译:BlockTurbo以太坊也因其可持续的货币政策和大量去中心化应用程序的生态系统受益,提供了有别于其他加密货币的价值主张.