来源:机器之心

纯文本大模型方兴未艾,多模态领域也开始涌现出多模态大模型工作,地表最强的GPT-4具备读图的多模态能力,但是迟迟未向公众开放体验,于是乎研究社区开始在这个方向上发力研究并开源。MiniGPT-4和LLaVA问世不久,阿里达摩院便推出mPLUG-Owl,一个基于模块化实现的多模态大模型。

今天要介绍的是mPLUG-Owl,该工作不仅通过大量cases展示出优秀的多模态能力,还第一次针对视觉相关的指令理解提出一个全?的测试集OwlEval,通过人工评测对比了已有模型,包括LLaVA、MiniGPT-4、BLIP-2以及系统类MM-REACT等工作,实验结果表明mPLUG-Owl展示出更优的多模态能力,尤其在多模态指令理解能力、多轮对话能力、知识推理能力等方?表现突出

Doodles社区委员会推出Launchpad计划:7月15日消息,NFT项目Doodles发推称,Doodles社区委员会已推出Launchpad计划“Inkubator”,旨在为Doodles的OG持有者提供包括社区活动、营销合作、商业实验、定制计划等支持。Inkubator的核心是社区资助,这些一次性赠款将提供给Doodles OG持有者。此外,Inkubator还引入了提案请求(RFP)的概念,成员可以通过将具体想法变为现实来竞争合同。该Launchpad平台下的第一个提案请求是驻场艺术家计划,旨在吸引社区艺术家创作GIF、独家艺术作品等,以扩大Doodles品牌影响力。接下来几周内,Doodles还计划为Inkubator推出更多功能,包括赠款、奖励和其他提案请求,推动平台不断发展,从而为社区提供新的参与和创新机会。[2023/7/15 10:56:52]

六月份加密货币交易量出现三个月来首次月度增长:金色财经报道,根据CCData的一份报告,六月份中心化交易所的现货和衍生品交易量合计增长了14%,达到2.71万亿美元。报告称,这是自三月份以来的首次月度增长。即便如此,现货交易量仍处于历史低位。上个月,几家知名美国机构向美国证券交易委员会(SEC)提交或重新提交了现货比特币ETF申请,其中包括景顺(Invesco)、WisdomTree以及富达(Fidelity)。

CCData表示,“美国证券交易委员会对币安美国和Coinbase提起诉讼后波动性增加,以及贝莱德和富达等公司提交现货比特币ETF后市场前景乐观,导致上个月交易活动增加。”[2023/7/5 22:19:20]

论文链接:https://arxiv.org/abs/2304.14178

代码链接:https://github.com/X-PLUG/mPLUG-Owl

ModelScope体验地址:

https://modelscope.cn/studios/damo/mPLUG-Owl/summary

HuggingFace体验地址:

https://huggingface.co/spaces/MAGAer13/mPLUG-Owl

多模态能力展示

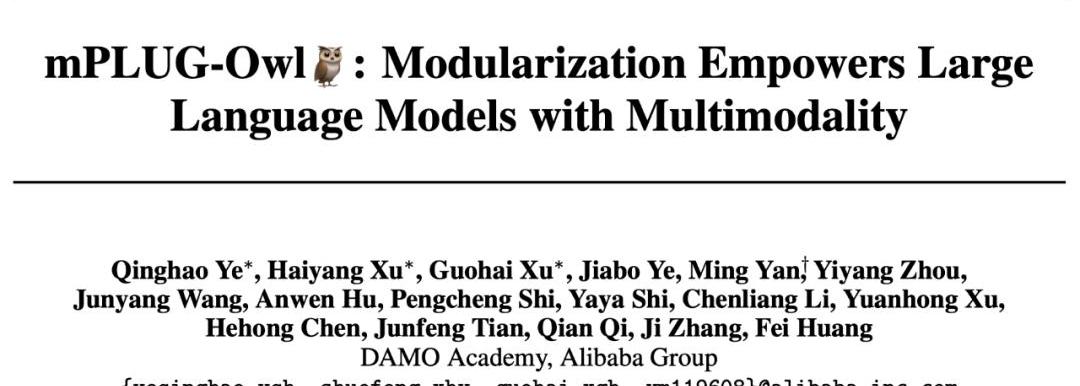

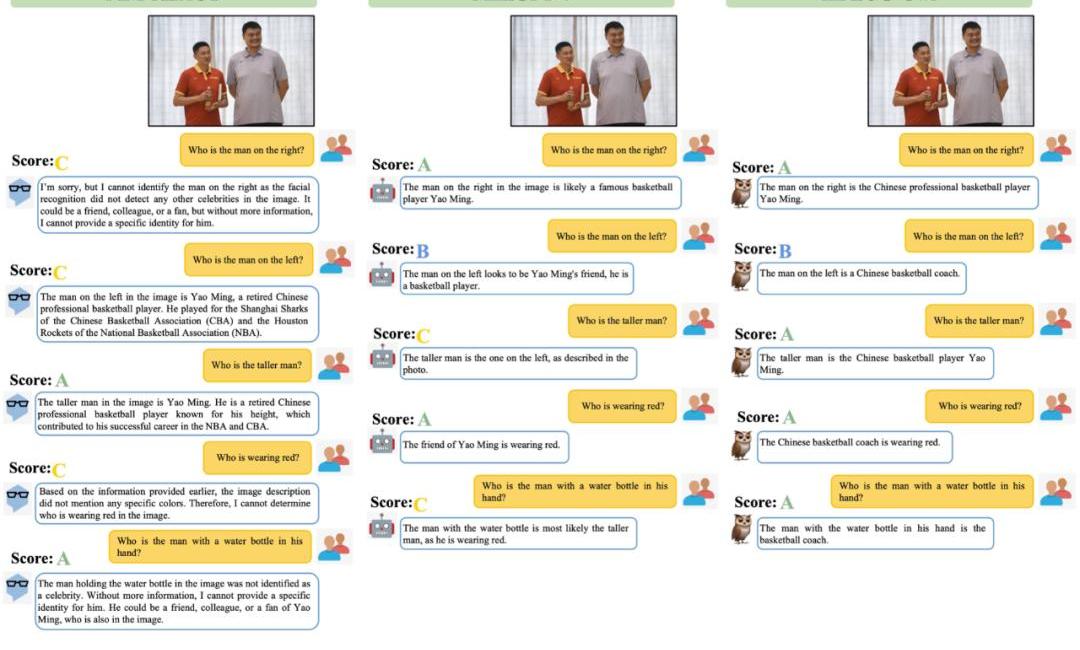

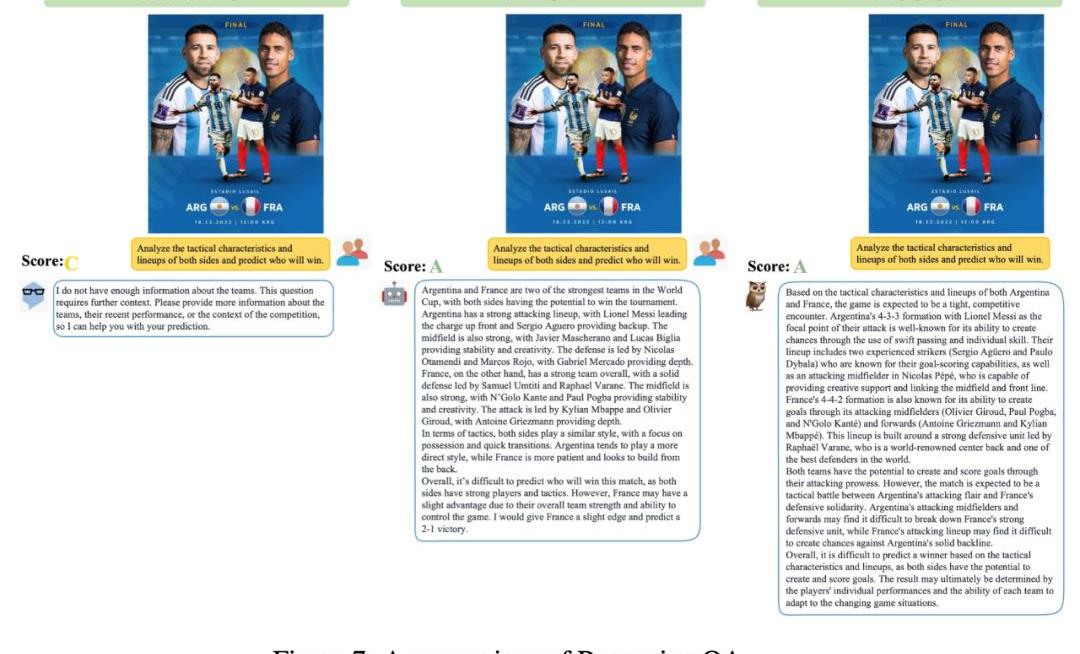

我们把mPLUG-Owl与现有工作进行对比来感受一下mPLUG-Owl的多模态效果,值得一提的是,该工作中评比的测试样例基本上都来自已有工作,避免了cherrypick问题。

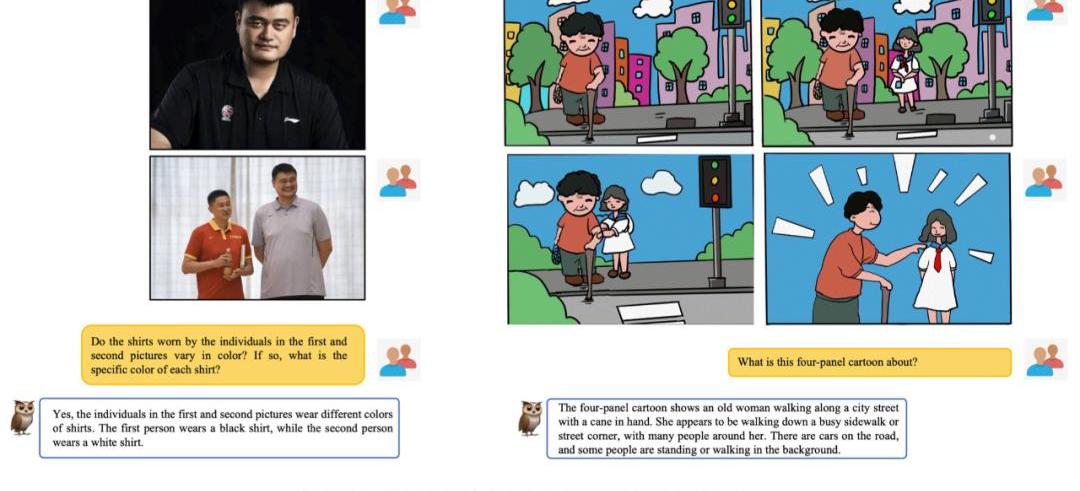

下图6展示了mPLUG-Owl很强的多轮对话能力。

从图7中可以发现,?mPLUG-Owl具有很强的推理能力。

如图9展示了一些笑话解释例?。

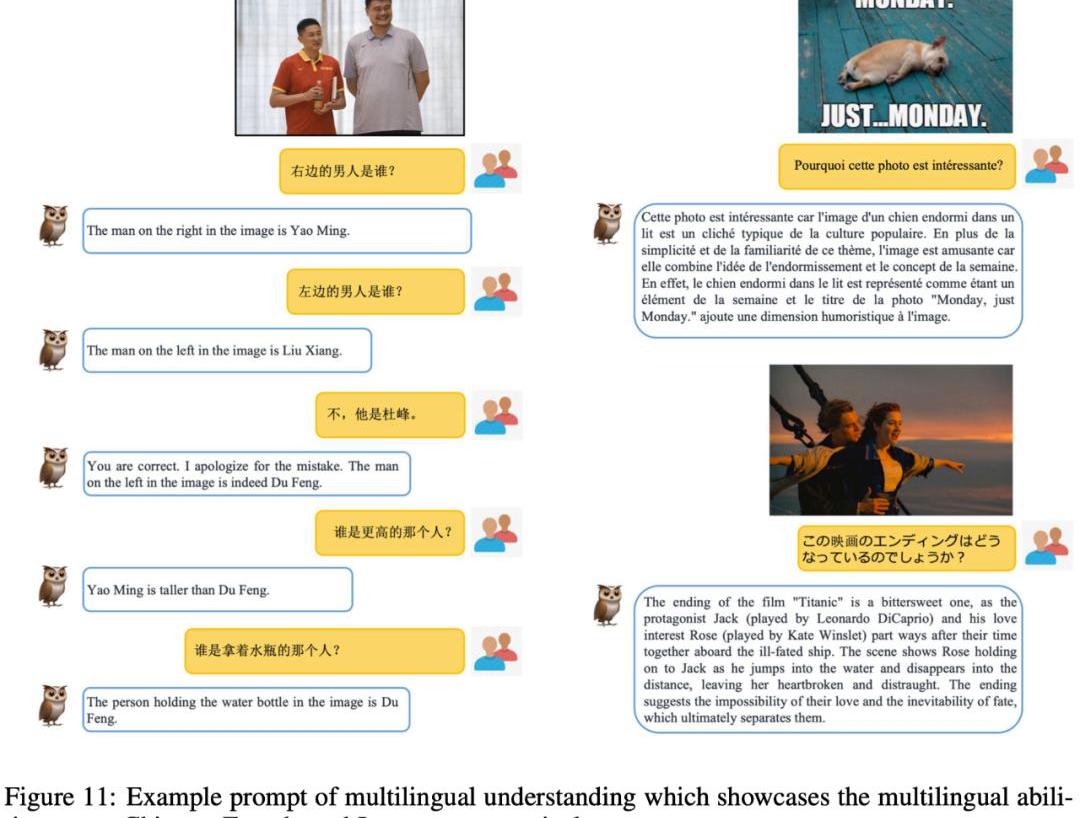

在该工作中,除了评测对比外,该研究团队还观察到mPLUG-Owl初显一些意想不到的能力,比如多图关联、多语?、文字识别和文档理解等能力。

如图10所示,虽然在训练阶段并没有进行多图关联数据的训练,mPLUG-Owl展现出了一定的多图关联能力。

如图11所示,尽管mPLUG-Owl在训练阶段仅使用了英文数据,但其展现出了有趣的多语?能力。这可能是因为mPLUG-Owl中的语?模型使用了LLaMA,从而出现了这一现象。

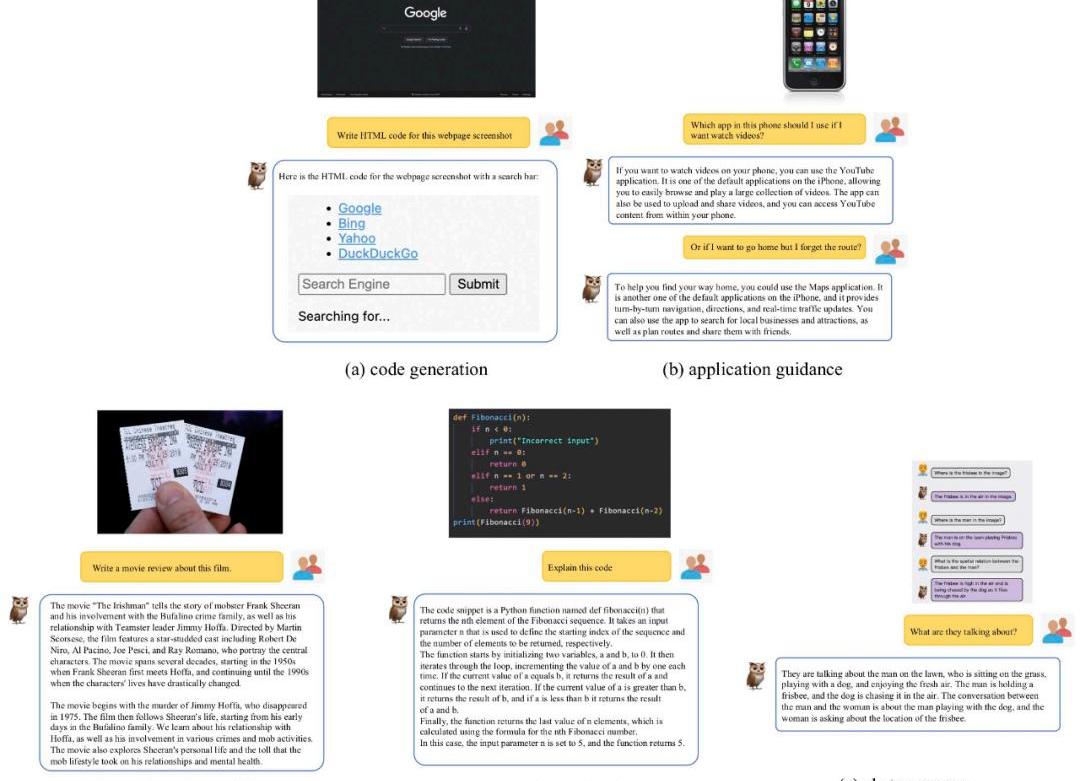

尽管mPLUG-Owl没有在带有标注的文档数据上进行训练,但其仍然展现出了一定的文字识别和文档理解能力,测试结果如图12所示。

方法介绍

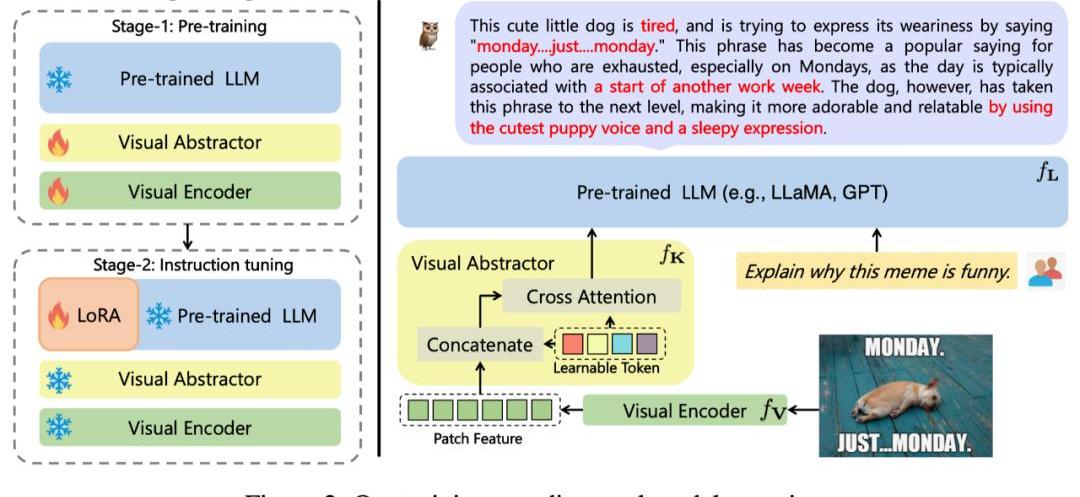

该工作提出的mPLUG-Owl,其整体架构如图2所示。

模型结构:它由视觉基础模块(开源的ViT-L)、视觉抽象模块以及预训练语?模型(LLaMA-7B)组成。视觉抽象模块将较?的、细粒度的图像特征概括为少量可学习的Token,从而实现对视觉信息的?效建模。?成的视觉Token与文本查询一起输?到语?模型中,以?成相应的回复。

模型训练:采用两阶段的训练方式

第一阶段:主要目的也是先学习视觉和语?模态间的对?。不同于先前的工作,?mPLUG-Owl提出冻住视觉基础模块会限制模型关联视觉知识和文本知识的能力。?因此mPLUG-Owl在第一阶段只冻住LLM的参数,采用LAION-400M,?COYO-700M,?CC以及MSCOCO训练视觉基础模块和视觉摘要模块。

第?阶段:延续mPLUG和mPLUG-2中不同模态混合训练对彼此有收益的发现,Owl在第?阶段的指令微调训练中也同时采用了纯文本的指令数据(52kfromAlpaca+90kfromVicuna+50kfromBaize)和多模态的指令数据(150kfromLLaVA)。作者通过详细的消融实验验证了引?纯文本指令微调在指令理解等方?带来的收益。第?阶段中视觉基础模块、视觉摘要模块和原始LLM的参数都被冻住,参考LoRA,只在LLM引?少量参数的adapter结构用于指令微调。

实验结果

SOTA对比

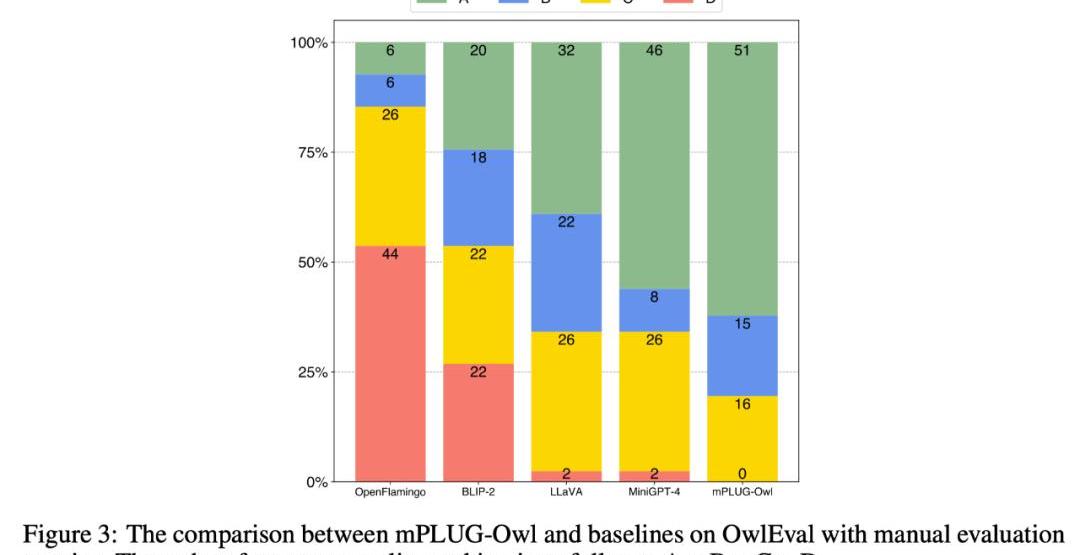

为了比较不同模型的多模态能力,该工作构建一个多模态指令评测集OwlEval。由于?前并没有合适的自动化指标,参考Self-Intruct对模型的回复进行人工评测,打分规则为:A="正确且令人满意";B="有一些不完美,但可以接受";C="理解了指令但是回复存在明显错误";D="完全不相关或不正确的回复"。

对比结果如下图3所示,实验证明Owl在视觉相关的指令回复任务上优于已有的OpenFlamingo、BLIP-2、LLaVA、MiniGPT-4。

多维度能力对比

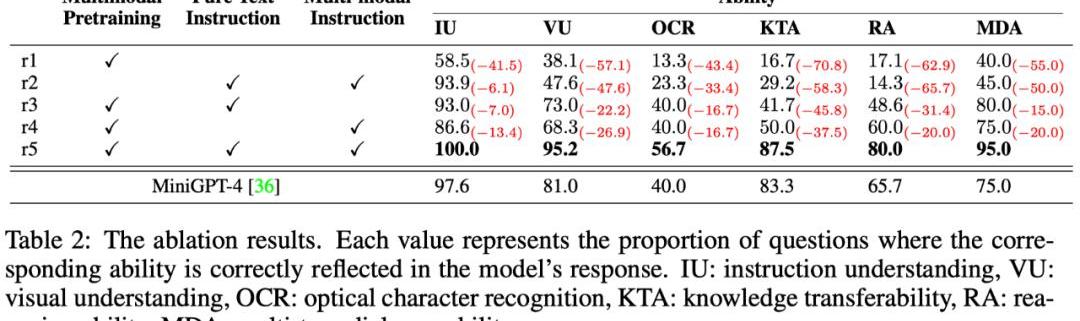

多模态指令回复任务中牵扯到多种能力,例如指令理解、视觉理解、图?上文字理解以及推理等。为了细粒度地探究模型在不同能力上的?平,本文进一步定义了多模态场景中的6种主要的能力,并对OwlEval每个测试指令人工标注了相关的能力要求以及模型的回复中体现了哪些能力。

结果如下表格6所示,在该部分实验,作者既进行了Owl的消融实验,验证了训练策略和多模态指令微调数据的有效性,也和上一个实验中表现最佳的baseline—MiniGPT4进行了对比,结果显示Owl在各个能力方?都优于MiniGPT4。

原文作者:LouisSong原文编译:GWEIResearchWebAssembly是一种广泛采用的虚拟机,它彻底改变了Web开发.

来源:深瞳商业,作者:河马君、楚青舟众所周知,小红书已经筹备“大模型”团队。据36氪5月6日消息,小红书自3月起开始筹备建立独立的大模型团队,核心员工来自广告业务的NLP技术团队.

众所周知,以太坊的发展面临着新困境。以太坊每天支持大量的经济活动、结算数十亿美元的交易,在蓬勃发展的DeFi和NFT领域中运行成千上万的DApp.

来源:Coinmonks加密货币的世界在不断发展和扩大,每天都有新的代币被创造。MemeCoins是当下最热门的成员之一,它是幽默+加密的独特而有趣的组合.

作者:科技新知 图片来源:由无界AI工具生成ChatGPT的横空出世,算是接管了元宇宙的“疯狂游戏”。由后者衍生出的数字人产业,虽然商业路径屡受质疑,但如今借着AI东风,再次被炒得火热.

黄尹旭:中国人民大学交叉科学研究院讲师、法学博士 要目 一、问题的提出? 二、Web2.0架构中“围墙花园”式垄断源起:中心化的平台力量三、破除Web2.